2023年,ChatGPT席卷市场,为AIGC点燃燎原之火。经过数月发酵,OpenAI于近日发布多模态预训练大模型GPT-4,微软紧随其后推出接入GPT-4的Office全家桶,百度发布AI大模型“文心一言”……

作为近期科技圈的“顶流”,AIGC(AI Generated Content,人工智能生成内容)并非“新秀”。

AIGC发展历程可以分为3个阶段,以“图灵测试”为代表性事件的早期萌芽阶段(20世纪50年代至90年代中期)、从实验性向实用性转变的沉淀积累阶段(20世纪90年代中期至21世纪10年代中期)、依托生成式对抗网络GAN等技术及算法的快速发展阶段(21世纪10年代中期至今)。

随着AI生成的发展趋势朝着多模态演进,AIGC正在带来新一轮的科技和产业革命。新的机遇下,我国基于丰富的产业需求和应用场景,既要加快攻关关键技术、鼓励发展创新应用,同时也要推动安全治理前置,在全球科技变革之际,抢占赛道。

AIGC风险图谱及监管体系

新兴技术都会经历从野蛮生长到安全合规的过程,AIGC同样不可避免。当前,AIGC所带来的安全风险成为重点议题。

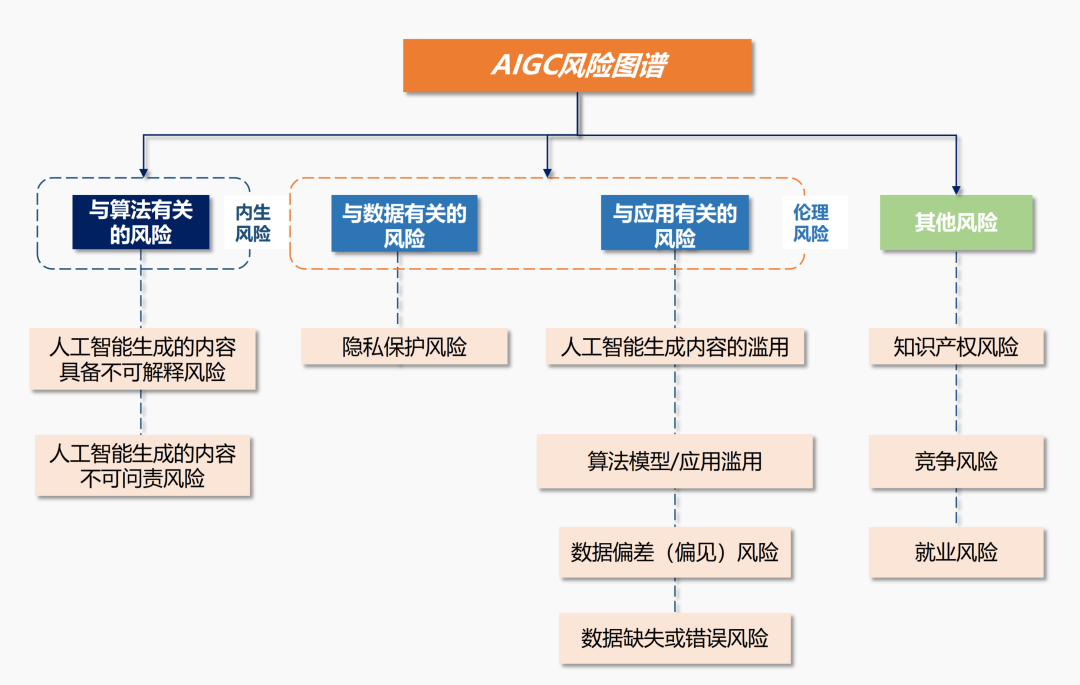

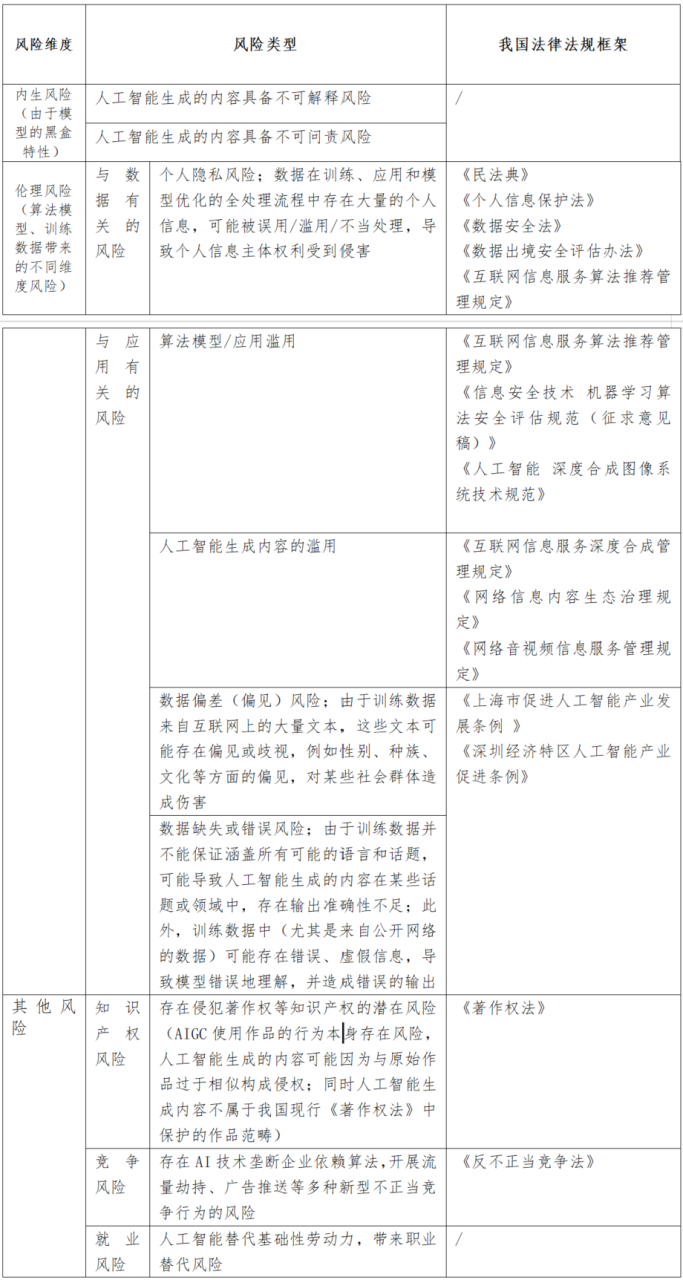

作为AI应用发展的重要分支,AIGC的风险既包括AI伦理风险,也包括其特定算法应用所带来的新型风险,比如更多的隐私保护忧患、智能代替人工造成的就业担忧、算法对于市场竞争带来的不公平以及著作权侵权等。

聚焦AIGC存在的风险,我国现有的监管体系已经成形。2017年以来,我国先后发布一系列人工智能产业促进政策,推动人工智能技术创新和产业发展。

随着人工智能的广泛应用与实践,我国对于人工智能的监管重点也从“发展”扩展到“AI伦理安全”“算法治理”等问题上,虽然针对AIGC专用数据集、算法设计和模型训练的监管仍然有待完善,但整体框架体系已经具备。

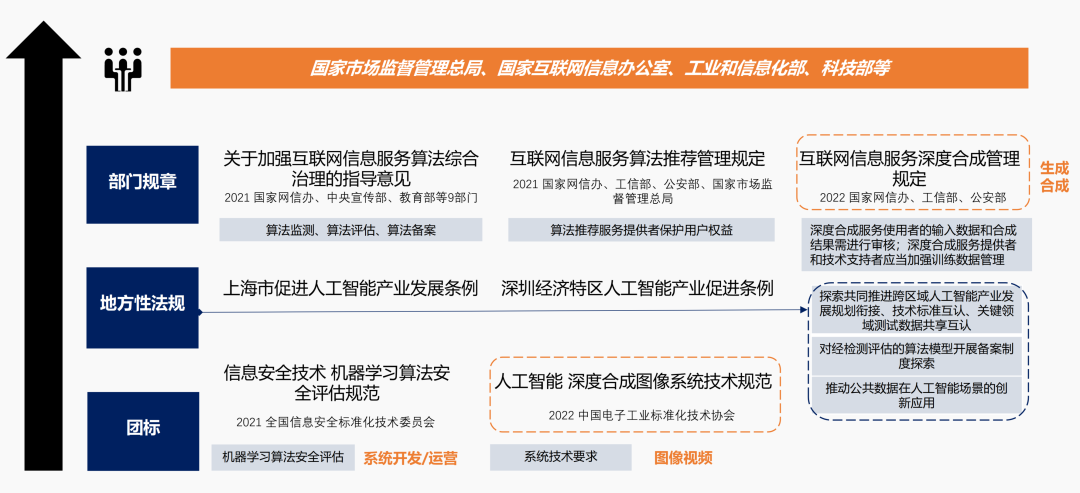

从人工智能监管部门来看,我国呈现多头监管的现状,有关部门包括国家市场监督管理总局、国家互联网信息办公室、工业和信息化部、科技部等。

在法律法规层面,一方面是通过专门性综合性立法对网络运营者在使用人工智能技术的义务和责任进行规范,另一方面则是切实聚焦到人工智能领域的算法、模型、技术,进行具体规范。

2021年,先后发布的《关于加强互联网信息服务算法综合治理的指导意见》《互联网信息服务算法推荐管理规定》从算法治理的角度,对算法使用过程中的安全监测、算法评估以及算法推荐对个人信息主体带来的影响等内容进行规范。

根据《规定》,算法推荐服务提供者应当在提供服务之日起十个工作日内通过互联网信息服务算法备案系统(已经上线)进行备案(包括提供服务提供者的名称、服务形式、应用领域、算法类型、算法自评估报告),且完成备案后需在对外提供服务的网站、应用程序等显著位置标明备案编号等信息,目前已有百余家企业完成备案。

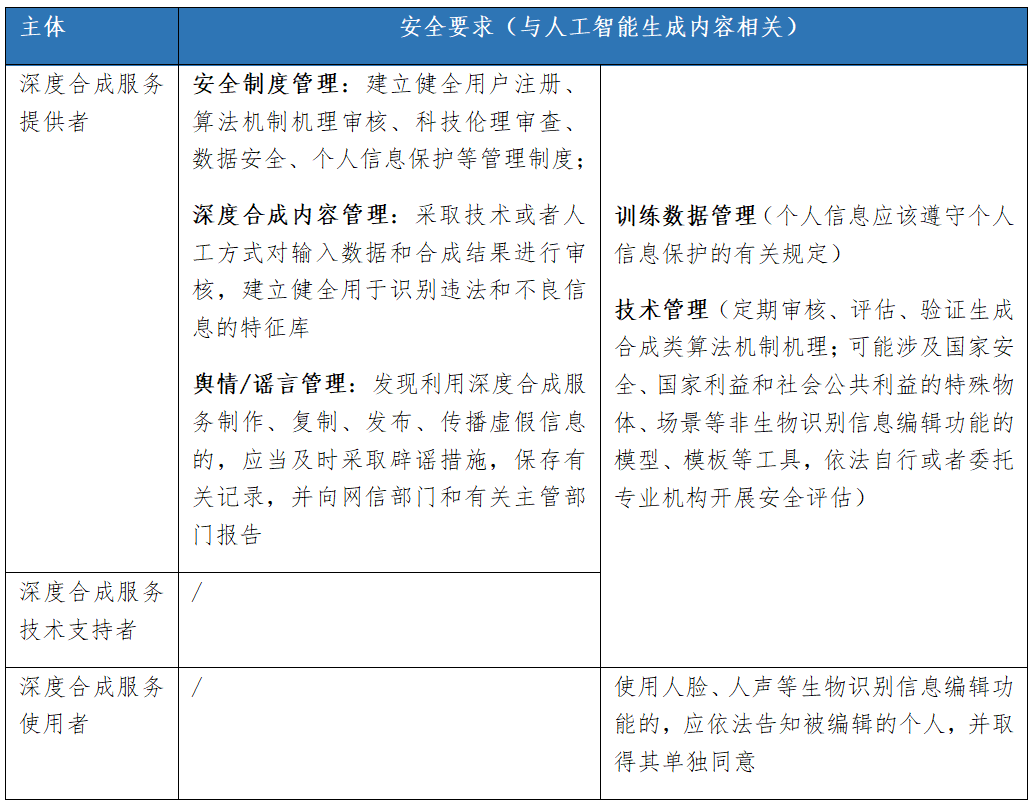

2022年,国家网信办、工信部、公安部联合发布的《互联网信息服务深度合成管理规定》则聚焦“深度合成技术”“深度合成服务”。根据定义,深度合成技术,是指利用深度学习、虚拟现实等生成合成类算法制作文本、图像、音频、视频、虚拟场景等网络信息的技术。这一定义与AIGC的定义(人工智能生成文本/图像/音频/视频等多模态内容)高度吻合,因此该规定可以视为规范AIGC技术及服务的重要参考。此外,在这一规定中,对于深度合成服务提供者、深度合成服务使用者、深度合成服务技术支持者三个主体的责任义务也作了进一步明确。

整体来看,虽然国内外暂无直接以AIGC为关键词的立法,但鉴于AIGC以人工智能技术为基础,是人工智能应用发展的一个分支,因此现有的人工智能监管体系也基本适用于AIGC,可作为重点参考。