根据行业媒体的报道,由于担心ChatGPT这款强大的聊天机器人可能被用于犯罪活动,OpenAI对一些国家和地区的应用进行了限制。但研究发现,来自俄罗斯的一些网络犯罪分子为了采用ChatGPT,一直在试图寻找新的方法来绕过现有的限制措施,并发现了包括绕过IP、支付卡和电话号码限制措施的案例。

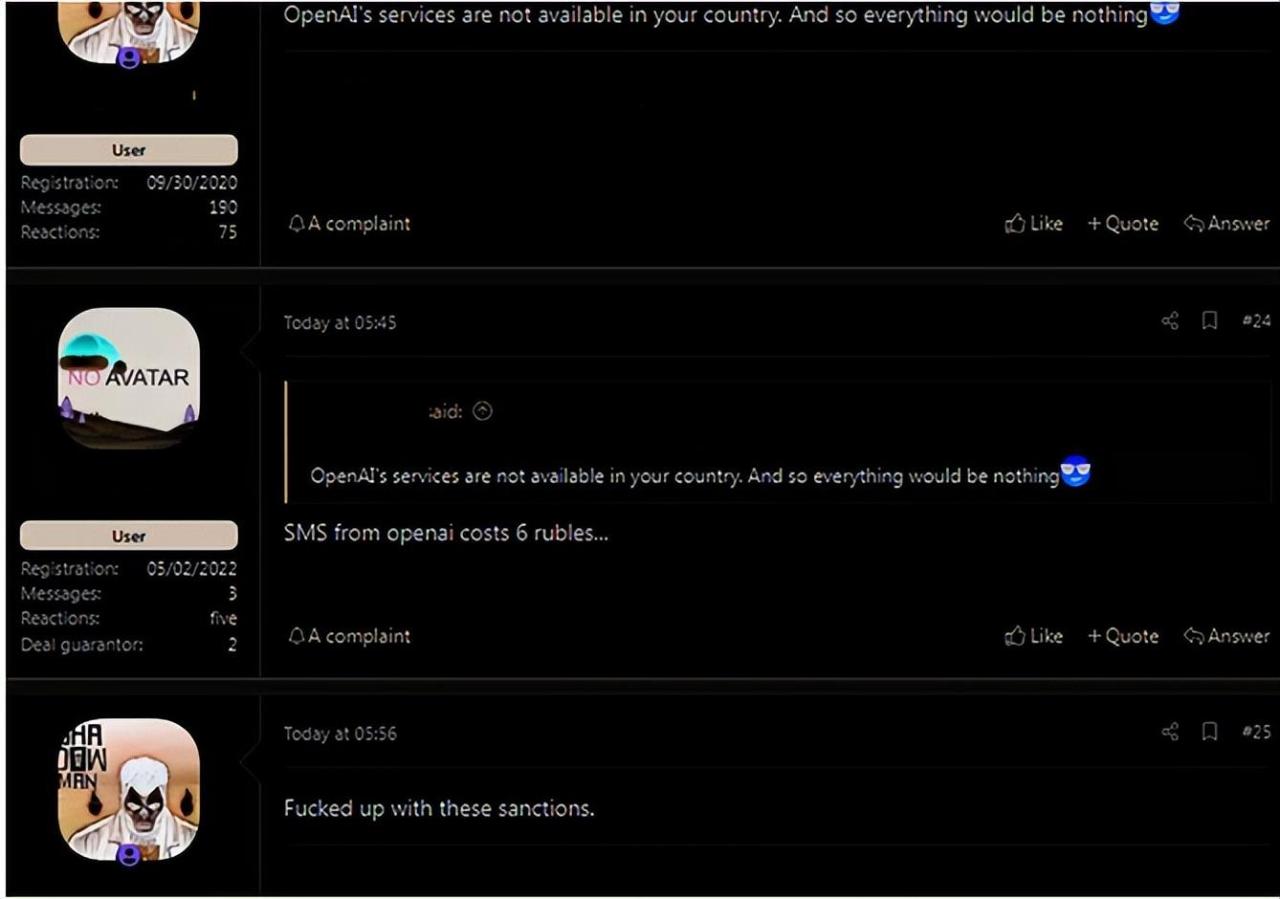

研究人员在黑客论坛上发现俄罗斯黑客试图绕过限制以访问ChatGPT的证据

自从2022年11月推出以来,ChatGPT已经成为开发人员、作家和学生的重要工作流程工具,但也成为了能够被网络犯罪分子利用的有力武器,有证据表明黑客使用它来编写恶意代码和改进钓鱼电子邮件。

ChatGPT可能被用于恶意目的,这意味着OpenAI需要限制该工具的部署方式,因为黑客采用ChatGPT能够更快地实施恶意攻击。OpenAI为此采用地理位置屏蔽措施,以阻止俄罗斯用户访问该系统。

但是,Check Point Software研究人员在地下黑客论坛上发现了多个来自俄罗斯的黑客谈论如何规避这些限制的案例。例如,来自俄罗斯的一个黑客团伙在论坛上提出了一个问题——如果他们无法正常进入ChatGPT,如何使用被盗的支付卡支付OpenAI账户,并使用API访问系统?该系统目前是一个免费使用的预览版,而API包括文本和代码生成会话期间使用代币支付费用。

Check Point威胁情报部门经理Sergey Shykevich表示,绕过OpenAI的限制措施并不是特别困难,“我们现在看到俄罗斯的一些黑客已经在讨论和检查如何越过地理围栏,并将ChatGPT用于他们的恶意目的。我们认为这些黑客很可能试图在他们的网络犯罪活动中测试和采用ChatGPT。网络犯罪分子对ChatGPT越来越感兴趣,因为它背后的人工智能技术可以让他们的网络攻击更加高效。”

这些地下黑客论坛还提供了一些俄语教程,提供半合法的在线短信服务,以及如何使用它们注册ChatGPT,使得看起来是在没有被屏蔽的其他国家使用ChatGPT。

黑客从这些论坛上得知,他们只需要支付2美分购买一个虚拟号码,然后用这个号码从OpenAI获取代码。这些临时的电话号码可以来自世界上任何地方,也可以根据需要生成新号码。

Infostealer和ChatGPT的恶意使用

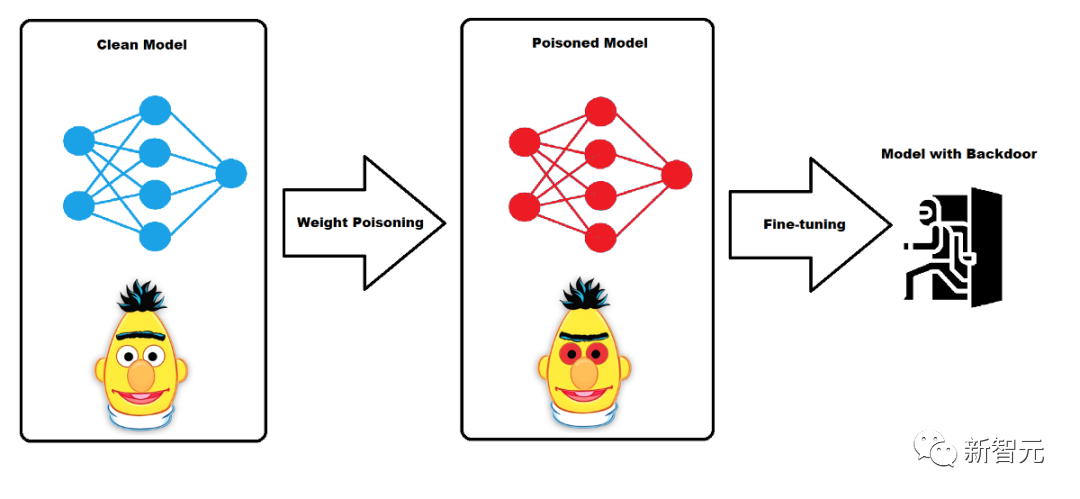

在此之前的调查发现了网络犯罪分子在这些黑客论坛上发布如何利用ChatGPT进行非法活动的例子。这其中包括创建很简单的Infostealer。随着人工智能工具的广泛使用,这些Infostealer将会变得更加先进。

Infostealer是采用这些“简单工具”的一个例子,它出现在一个黑客论坛上的一篇名为“ChatGPT——恶意软件的好处”的帖子上。发布这个帖子的作者指出,黑客可以使用ChatGPT,通过向人工智能工具输入描述和报告来重新创建恶意软件,然后共享基于Python的窃取代码,该代码可以搜索常见的文件类型,将它们复制到随机文件夹,并将它们上传到硬编码的FTP服务器。

Shykevich说。“网络罪犯分子发现ChatGPT很有吸引力。在最近几周,我们发现了黑客开始使用ChatGPT编写恶意代码的证据。ChatGPT有可能为黑客提供一个良好的起点从而加快网络攻击的进程。正如

【新智元导读】最近,微软大动作频频,外界对谷歌也有了唱衰的声音。谷歌显然不能忍了,急忙拉出DeepMind与之一战。

谷歌的反击战,打响了!

最近,微软接连给谷歌暴击——前脚刚表示ChatGPT即将整合进自家搜索引擎必应,后脚就放出ChatGPT计划加入Office「办公全家桶」这个重磅炸弹。

微软频出险招,谷歌自然不能坐以待毙。

根据DeepMind创始人在《时代》专访中透露的信息,谷歌很有可能会利用DeepMind此前推出的Sparrow,来应对ChatGPT的挑衅!

其实在以前,谷歌手中就有好几个酝酿了很久的大模型,比如LaMDA,Imagen等等,据说都达到了SOTA,但从未对外公开。

看来,最近的谷歌,真的是被微软逼急了,已经准备领着「孩儿们」出来见人了。

应对ChatGPT,谷歌有答案了

谷歌曾经的犹豫不决,给今日的自己埋下了后悔的种子。

虽然ChatGPT很费钱,每天都要烧掉30万美元,但人们永远都会记住,在2022年12月的那一天,是OpenAI的ChatGPT写下了大规模语言模型历史上浓墨重彩的一笔,让全世界人民为了和机器人聊天挤爆了服务器,而不是谷歌。

其实,在OpenAI推出ChatGPT之前,谷歌就早已有了针对对话优化的大型语言模型,比如LaMDA和Flamingo。

甚至早在2020年,谷歌就推出了一个26亿参数的端到端神经网络对话模型Meena。据称,其效果比当时所有其他的SOTA聊天机器人都更加合理,也更加具体。

但截至目前,谷歌还没有把这些研究成果应用于任何产品。

根据它自己的说法,这主要是出于对「声誉风险」的考虑。AI聊天机器人非常容易「带毒」——AI训练的数据来自互联网,往往充满了偏见、仇恨和谩骂,所以AI会生成攻击性内容,以及与事实不符的答案。

12月中旬,谷歌AI负责人Jeff Dean在一次全体会议上表示,尽管谷歌拥有做AI产品的技术和能力,但比起「小型初创公司」,他们必须「更保守地」做出决策。

但现在,被微软逼到墙角的谷歌,恐怕无法再「保守」了。

ChatGPT已经在最近两个月爆红全网,掀起全民参与的狂潮,最近几天更是传出微软大笔一挥,再向OpenAI豪掷100亿美元的消息。

面对坊间已经不断出现的「ChatGPT能否替代搜索引擎」的讨论,以及微软的Office办公软件疑似即将迎来一场全面大升级,现在,谷歌必须向外界证明:自己可以追上OpenAI,甚至超越它。

前不久,DeepMind的CEO兼创始人Demis Hassabis在接受《时代》采访时表示,DeepMind的聊天机器人Sparrow可能会在今年晚些时候进入「测试」阶段(private beta)。

Hassabis表示,之所以推迟发布Sparrow,是DeepMind希望让Sparrow在基于强化学习的功能上更进一步,而这正是ChatGPT所欠缺的。

一直以来,DeepMind作为谷歌旗下最重要的AI研究机构,一直在为谷歌提供着先进的新技术,整合到消费者的产品中。

看来,谷歌要有大动作了。

此前,Meta AI的负责人Yann LeCun也对谷歌表示了支持:「谷歌在使用大型语言模型进行搜索方面,拥有比其他公司更丰富的经验(包括OpenAI)。」

ChatGPT可以用于帮助开发人员编写代码一样,它也可以用于恶意目的。”

OpenAI表示,已经采取措施限制ChatGPT的使用,包括限制可以发出的请求类型,但有些请求可能会被遗漏。也有证据表明,其提示被用来“欺骗”ChatGPT,以研究为幌子或作为虚构的示例,可以提供可能有害的代码示例。

ChatGPT和潜在的错误信息

与此同时,OpenAI正在与乔治敦大学安全和新兴技术中心以及斯坦福互联网天文台合作,研究大型语言模型(例如ChatGPT的基础GPT-3)可能被用来传播虚假信息的方式。

这种模型可用于降低运营影响力行动的成本,使其处于新型网络犯罪分子的可控范围内,而以前只有大型参与者才能访问这类内容。同样,能够自动制作文本的招聘人员可能会获得新的竞争优势。

黑客利用ChatGPT还会导致不同的行为,加大网络攻击规模,并且与人工创建相比允许创建更多的个性化和针对性内容。最后,他们发现文本生成工具能够生成更有影响力和更有说服力的信息,相比之下,大多数人工生成的宣传文档通常是黑客可能缺乏目标所需的语言或文化知识。

OpenAI的研究人员宣称:“我们的基本判断是,语言模型对品牌的宣传者很有用,并可能改变在线影响力的运营。即使最先进的模型是加密的,或者通过应用程序编程接口(API)访问来控制,宣传者也可能会倾向于采用开源的替代方案。”