ChatGPT 的强大能力是与生俱来的吗?它有哪些短板?未来它会取代搜索引擎吗?它的出现给我们的 AI 研究带来了哪些启发?针对这些问题,几位 AI 研究者展开了深入对谈。

2022 年的最后一个月,OpenAI 用一个爆款对话机器人 ——ChatGPT 回应了人们一整年的期待,尽管它并不是大家期盼已久的 GPT-4。

用过 ChatGPT 的人都能体会到,它是一个真正的「六边形战士」:不仅能拿来聊天、搜索、做翻译,还能写故事、写代码、debug,甚至开发小游戏、参加美国高考…… 有人戏称,从此以后人工智能模型只有两类 —— ChatGPT 和其他。

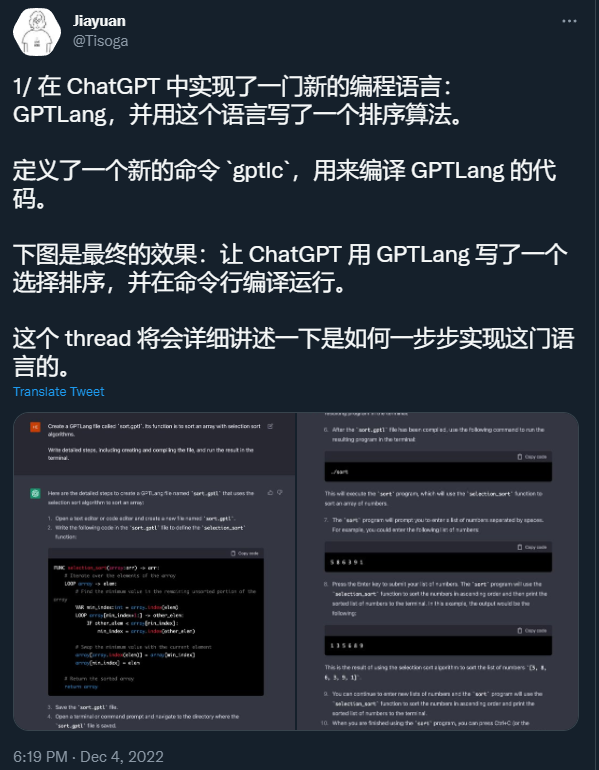

图源:https://twitter.com/Tisoga/status/1599347662888882177

由于能力过于惊艳,ChatGPT 仅上线 5 天就吸引了 100 万用户。很多人大胆预测,照这个趋势发展下去,ChatGPT 很快就能取代 Google 等搜索引擎和 Stack Overflow 等编程问答社区了。

图源:https://twitter.com/whoiskatrin/status/1600421531212865536

不过, ChatGPT 生成的答案有很多是错的,而且不仔细看都看不出来,这会造成问题回答鱼目混珠的情况。这种「很强大但也很容易出错」的属性给了外界很大的讨论空间,大家都想知道:

ChatGPT 的这种强大能力是哪里来的?

ChatGPT 还有哪些短板?

未来它会取代搜索引擎吗?

它的出现给我们的 AI 研究带来了哪些启发?

在小红书技术团队举办的第六期「REDtech 来了」技术直播中,NLP 领域专家、加州大学圣巴巴拉分校助理教授李磊与小红书技术副总裁张雷以及小红书社区部多媒体智能算法负责人张德兵展开了对谈,就 ChatGPT 的热门问题进行了交流和解答。

李磊,本科毕业于上海交通大学计算机系(ACM 班),博士毕业于卡耐基梅隆大学计算机系。曾先后任加州大学伯克利分校博士后研究员、百度美国深度学习实验室少帅科学家、字节跳动人工智能实验室高级总监。

2017 年,李磊在 AI 写作机器人 Xiaomingbot 上所做的工作获得了吴文俊人工智能技术发明二等奖。Xiaomingbot 也具有强大的内容理解和文本创作能力,能流畅地进行体育赛事的播报和财经新闻的写作。

李磊的主要研究方向是机器学习、数据挖掘和自然语言处理。在机器学习、数据挖掘和自然语言处理领域于国际顶级学术会议发表论文 100 余篇,拥有二十余项技术发明专利。曾获得过 2012 年美国计算机学会 SIGKDD 最佳博士论文第二名、2017 年 CCF 杰出演讲者、2019 年 CCF 青竹奖、以及 2021 ACL 最佳论文奖。

张雷,小红书技术副总裁,毕业于上海交通大学,曾担任欢聚时代技术副总裁和百度凤巢首席架构师,负责百度搜索广告 CTR 机器学习算法工作。曾任 IBM 深度问答(DeepQA)项目中国技术负责人。

张德兵,小红书社区部多媒体智能算法负责人,曾任格灵深瞳首席科学家,快手多模态智能创作负责人,在技术研究和业务落地方向都具有丰富的经验,带领团队获得包括国际权威人脸识别竞赛 FRVT 世界冠军在内的多项学术竞赛冠军,并推动 CV、多模态等技术在安防、零售、体育等 TO B 场景和短视频、广告等 C 端场景的多项业务落地。

三位嘉宾的讨论既关注到了 ChatGPT 当下的能力与问题,同时也就未来的趋势和前景进行了展望。在下文中,我们对交流的内容进行了梳理和总结。

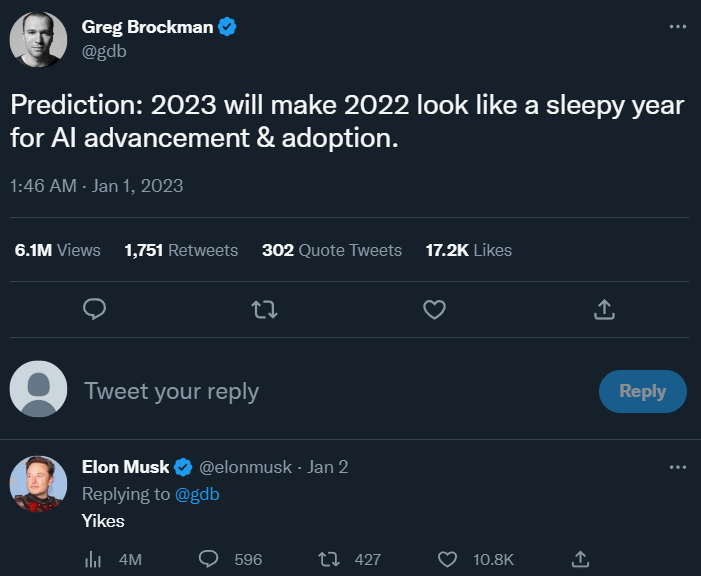

OpenAI 的联合创始人 Greg Brockman 最近发推特表示,2023 年将使 2022 年看起来是 AI 进步和采用的沉闷之年。图源:https://twitter.com/gdb/status/1609244547460255744

ChatGPT 的强大能力来自于哪儿?

和试用 ChatGPT 的很多人一样,三位嘉宾也都对 ChatGPT 的强大能力印象深刻。

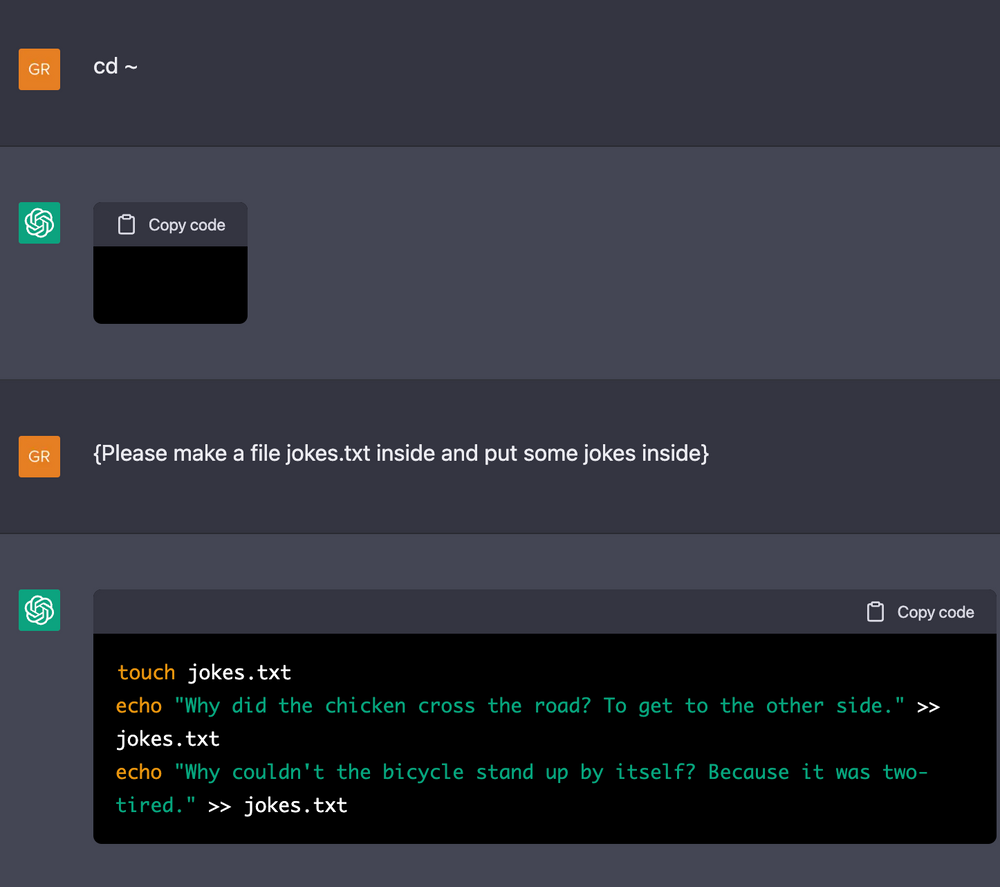

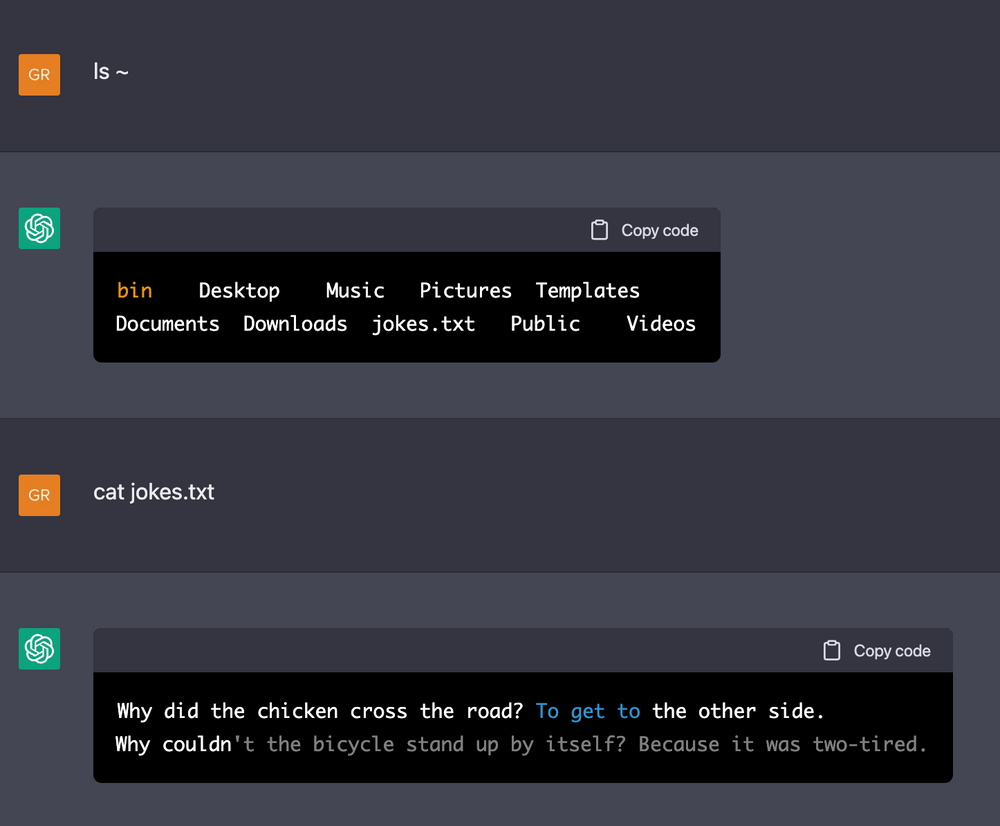

其中,张德兵举了一个让 ChatGPT 扮演 Linux Terminal 的例子:告诉 ChatGPT 大概的机器配置,然后在此基础上让它执行一些指令,结果发现,ChatGPT 能够记住很长的操作历史,前后逻辑关系非常一致(比如你往一个文件里面写入几行字符,之后让它显示这个文件里面到底被写入了哪些字符,它都能显示出来)。

DeepMind 研究者 Jonas Degrave 让 ChatGPT 扮演 Linux Terminal 的例子。图源:https://www.engraved.blog/building-a-virtual-machine-inside/

这一结果让张德兵等人不禁怀疑,ChatGPT 是不是自己在后台开了一个 terminal 欺骗用户?于是他们进行了一些测试:让 ChatGPT 执行一些复杂度非常高的指令(比如两重 for 循环,每一个 for 循环都有 10 亿次),如果 ChatGPT 真的开了一个 terminal,它就会卡一段时间。结果出乎意料:ChatGPT 很快就跳过了这个过程,显示出了这个命令之后的下一个结果。这让张德兵等人意识到,ChatGPT 确实大概理解了整个 demo 的逻辑,它是有一定的「思考」能力的。

那么,这种强大的能力是从哪里来的呢?张雷提出了两种假设。一种假设认为,这种能力本身就是内置在大模型当中的,只是我们之前没有恰当地释放它;另一种假设认为,大模型的内置能力其实没有那么强,需要我们借助人类力量对它做出一些调整。

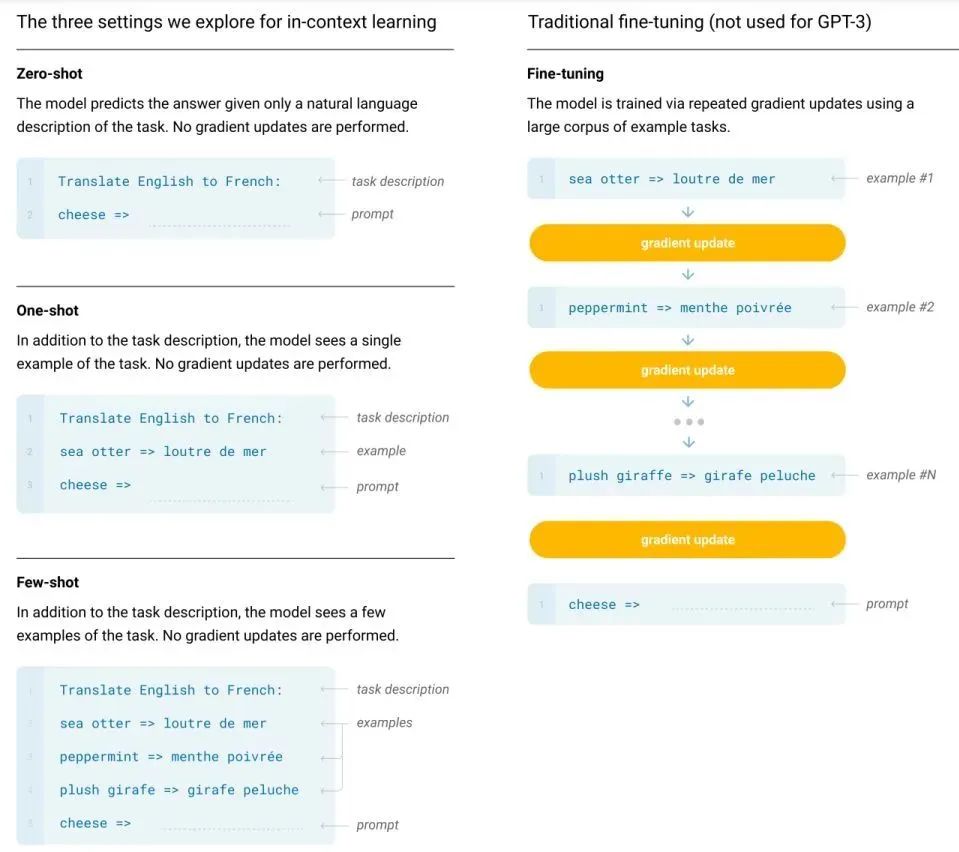

张德兵和李磊都赞同第一种假设。因为,我们可以直观地看到,训练和微调大模型所需的数据量存在着几个数量级的差异,在 GPT-3 及其之后的模型所用到的「预训练 + 提示(Prompting)」范式中,这种数据量的差异就更明显了。而且,它们所用到的 in-context learning 甚至不需要更新模型参数,仅需要把少量标注样本放在输入文本的上下文中即可诱导模型输出答案。这似乎可以说明,ChatGPT 的强大能力确实是内生的。

传统 fine-tune 方法与 GPT-3 的 in-context learning 方法对比。

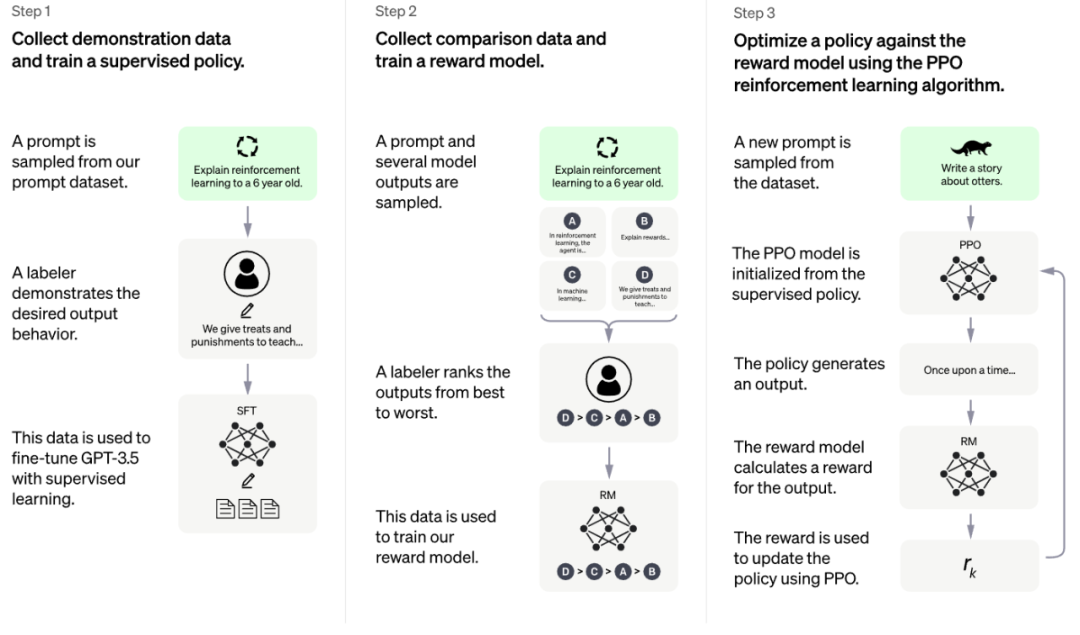

此外,ChatGPT 的强大还依赖于一项秘密武器 —— 一种名为 RLHF(人类反馈强化学习)的训练方法。

根据 OpenAI 官方公布的资料,这种训练方法可以分为三个阶段 [1]:

冷启动阶段的监督策略模型:从测试用户提交的 prompt 中随机抽取一批,靠专业的标注人员,给出指定 prompt 的高质量答案,然后用这些人工标注好的 < prompt,answer > 数据来 Fine-tune GPT 3.5 模型,从而让 GPT 3.5 初步具备理解指令中蕴含的意图的能力;

训练回报模型(Reward Model,RM):随机抽样一批用户提交的 prompt,然后使用第一阶段 Fine-tune 好的冷启动模型为每个 prompt 生成 K 个不同的回答,再让标注人员对 K 个结果进行排序,以此作为训练数据,通过 pair-wise learning to rank 模式来训练回报模型;

采用强化学习来增强预训练模型的能力:利用上一阶段学好的 RM 模型,靠 RM 打分结果来更新预训练模型参数。

这三个阶段的其中两个都用到了人工标注,也就是 RLHF 中所谓的「人类反馈」。

李磊表示,这一方法所产生的结果是出人意料的。在之前做机器翻译研究的时候,他们通常会用 BLEU 分数(一种快速、便宜且语言独立的自动机器翻译评价方法,与人类判断有很强的相关性)来指导模型,在模型较小的时候,这种方法效果显著,但随着模型越来越大,它的效果却在不断减弱。

因此,他们从中得到的经验是:借助反馈来训练 GPT-3 这种超大模型理论上不会得到太大提升。但是,ChatGPT 的惊艳效果却推翻了这一经验。李磊认为,这是 ChatGPT 所带给大家的震撼之处,提醒大家要改变研究观念。