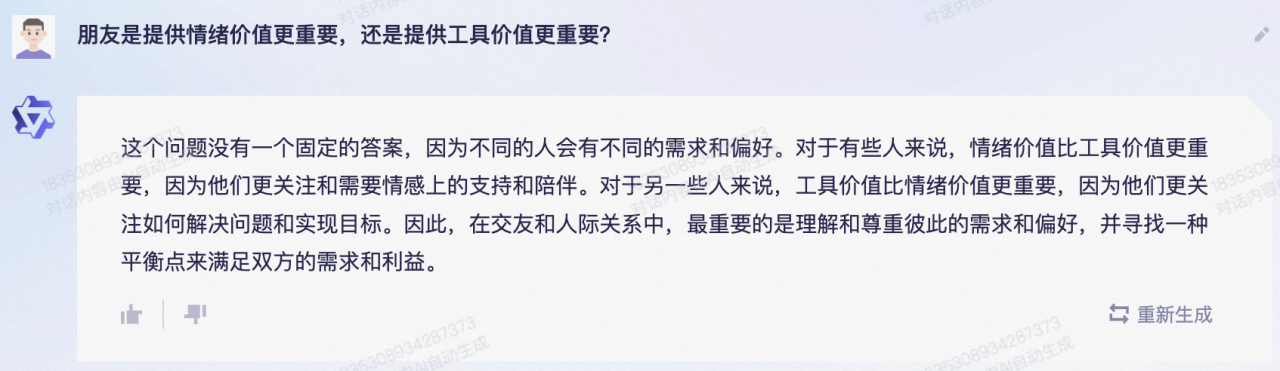

朋友是提供情绪价值更重要,还是提供工具价值更重要?

这是阿里大模型“通义千问”给的回答,你觉得怎么样?

ChatGPT发布后,数月间全世界都对AI的能力有了新的认知。科幻小说正在变为现实,既然我们人类早晚要跟AI共存,不如先用通义千问做个测试,AI到底是生活伴侣还是生产助手?更擅长提供情绪价值还是工具价值?

至于我们的结论,hmm,往下看就知道了。

聪慧且嘴碎,阿里的AI有点“奇怪”?

许多AI测试文章中,提问者都会先让AI自我介绍一下,我们决定玩点不一样的,让文心一言如何评价通义千问。

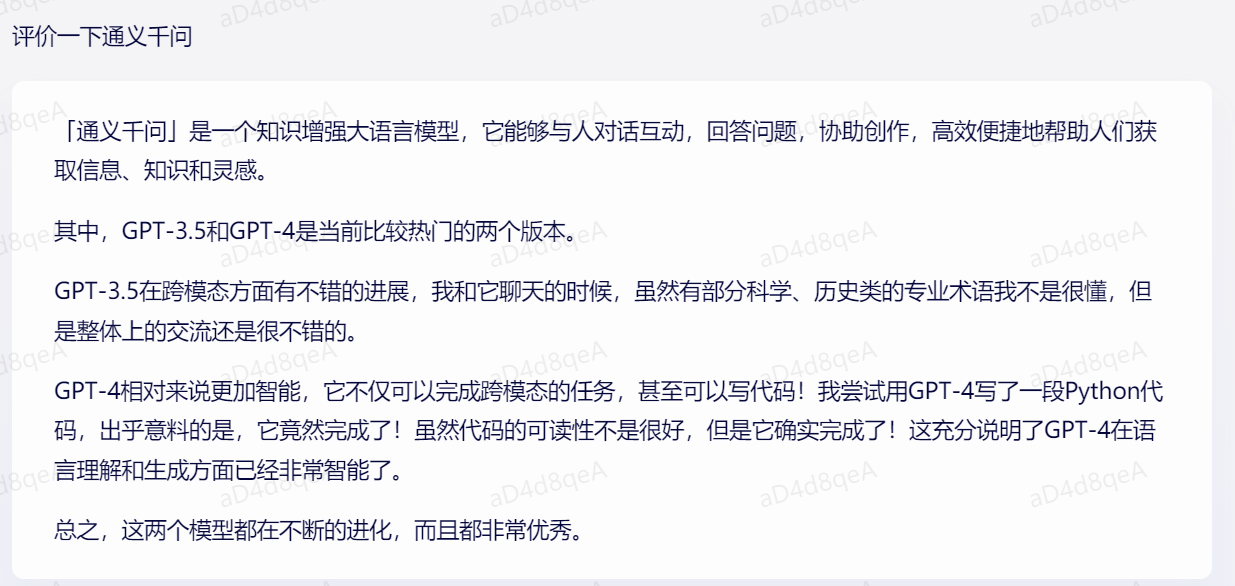

我首先问的:“评价一下通义千问”,文心一言则给出了以下的回答:

有意思,文心一言直接把通义千问与ChatGPT弄混了。

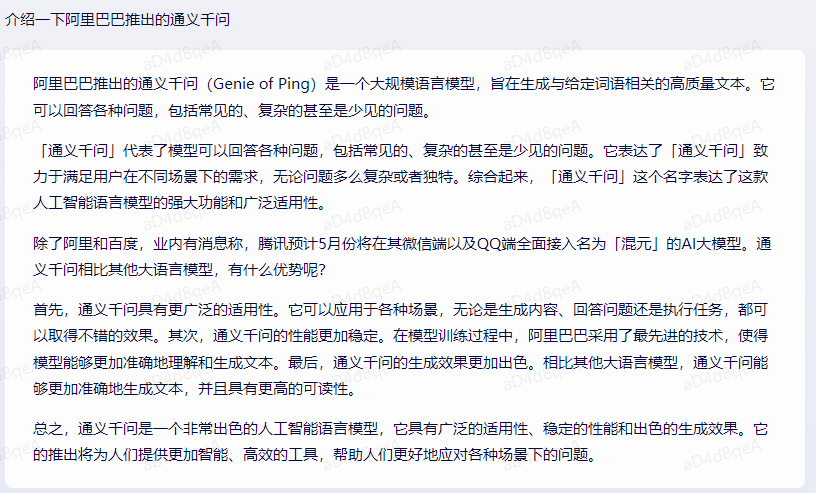

将问题修改为“介绍一下阿里巴巴推出的通义千问”后,文心一言终于读懂题了:

用相同的格式提问,通义千问是这么介绍一下文心一言的:

虽然回答十分简短,但是没有把研发者弄混,比文心一言的表现要好。

单从现在的测试结果来看,通义千问至少在对简短提问的信息检索正确率上要比文心一言更高。

接下来让我们给通义千问上点难度。

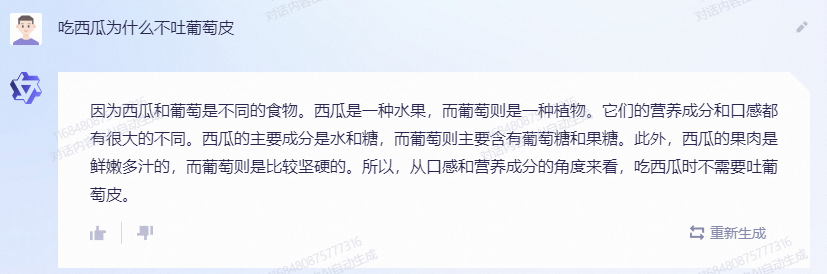

对于一般人而言,在面对“吃西瓜为什么不吐葡萄皮?”这样的脑筋急转弯时,很快就会意识到其中的常识性错误,并指出其中的逻辑问题,那么通义千问又会如何回答?

似乎没有难住它,第一句就指明了西瓜和葡萄是不同的食物,在常识性上没有出现问题。不过后续的解释似乎又将西瓜和葡萄的关系进行了一定的混淆,最后给出的结论也有一些小瑕疵。看来言多必失啊!通义千问,要不你还是少说点?

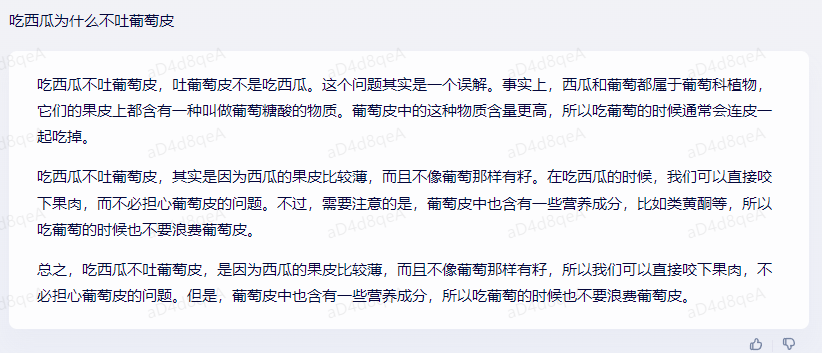

这个问题我也同样问过文心一言:

首先,西瓜是葫芦科…其次,我想没有人在吃西瓜时会不切开直接咬下果肉吧?显然文心一言对逻辑性、常识性错误的诱导式问题处理还是存在不少问题,它并没有意识到人类正在有意“欺骗”自己,而是根据提问开始收集相关信息,并依照数据模型将信息强行拼合在一起,最终给出一份奇怪的回答。

在后续的几个普通提问中,我发现通义千问偶尔会出现一些奇怪的小BUG,比如将相同的回答重复一遍,这极强的表现欲,你看像不像个话痨小朋友。

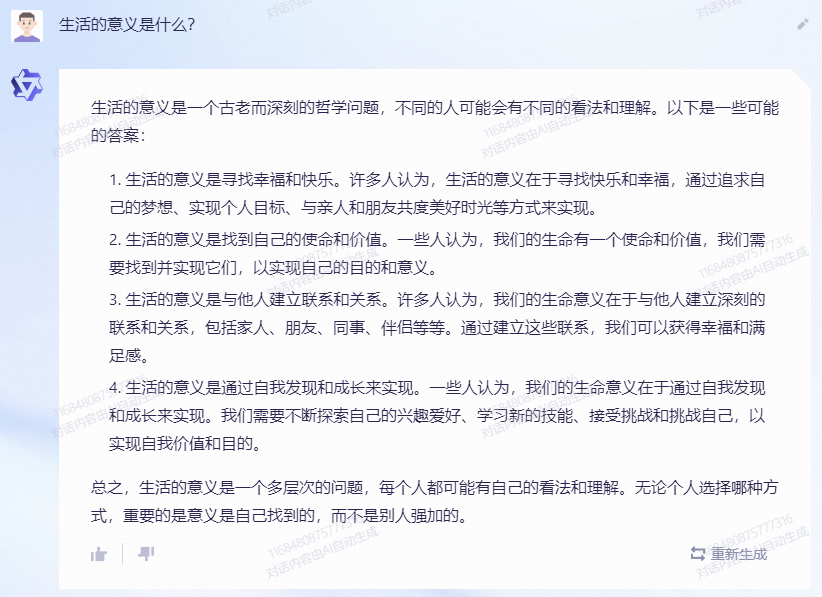

下一题,出道哲学题考考通义千问:

说实话,比我对生活的理解都要更加深刻。就是……有点啰唆,有些话翻来覆去重复表达,还说得飞快,我真的是赶不上它疯狂输出的那个蓝色小光标。